Die Eskalation zwischen dem Iran, Israel und den USA hat zu einer Welle viraler Kriegsfilme im Internet geführt. Viele der millionenfach abgerufenen Videos sind jedoch irreführend, falsch beschriftet, aus Videospielen entnommen oder vollständig von KI generiert.

Während die Krise im Nahen Osten eskaliert, werden die sozialen Medien mit einer noch nie dagewesenen Menge an irreführenden Videos und Bildern überschwemmt, die angeblich Angriffe und Militäraktionen sowohl in Israel als auch im Iran zeigen.

WERBUNG

WERBUNG

WERBUNG

WERBUNG

Doch viele der online verbreiteten Clips zeigen den Krieg gar nicht. Einige sind aus dem Zusammenhang gerissene Aufnahmen aus anderen Ländern, während andere, von Millionen Menschen gesehen, aus Videospielen stammen oder vollständig mithilfe von KI generiert wurden.

Hier sind drei virale Videos, die Hunderttausende Aufrufe erzielt haben, aber nicht das zeigen, was sie behaupten.

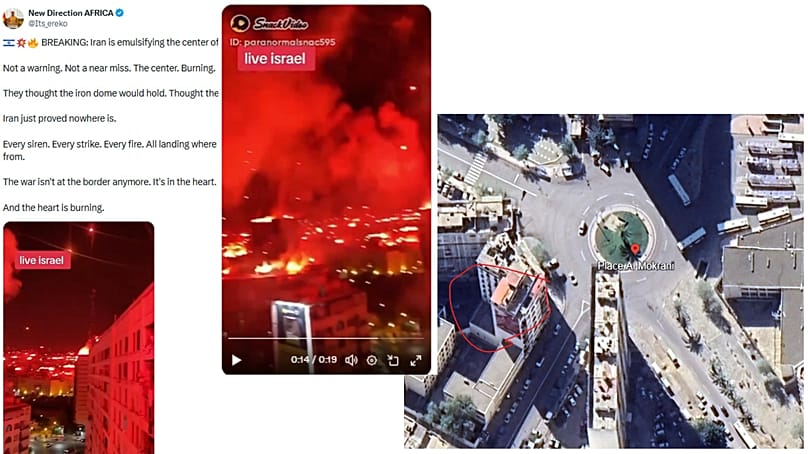

"Angriff auf Tel Aviv" oder algerische Fußballfeiern?

Ein auf X weit verbreitetes Video behauptet, iranische Raketen würden das Zentrum von Tel Aviv treffen.

Mehr als vier Millionen Menschen haben den Clip gesehen. Doch er zeigt nicht Tel Aviv. Tatsächlich stammt das Video aus Algerien und wurde bereits mehrfach als irreführend entlarvt.

Zu sehen sind Fußballfans, die den Sieg des algerischen Vereins CR Belouizdad feiern – nicht Raketen, die auf Israel einschlagen.

Wir konnten das Bildmaterial dem Al-Mokrani-Platz in Algier zuordnen. Der Verein hat seine Siege in der Vergangenheit mit ähnlichen Feuerwerken gefeiert, wie hier (Quelle auf Englisch) und hier zu sehen ist.

The Cube, das Faktencheck-Team von Euronews, entlarvte dasselbe Video bereits 2023, als es damals fälschlicherweise als israelischer Angriff auf Gaza verbreitet wurde.

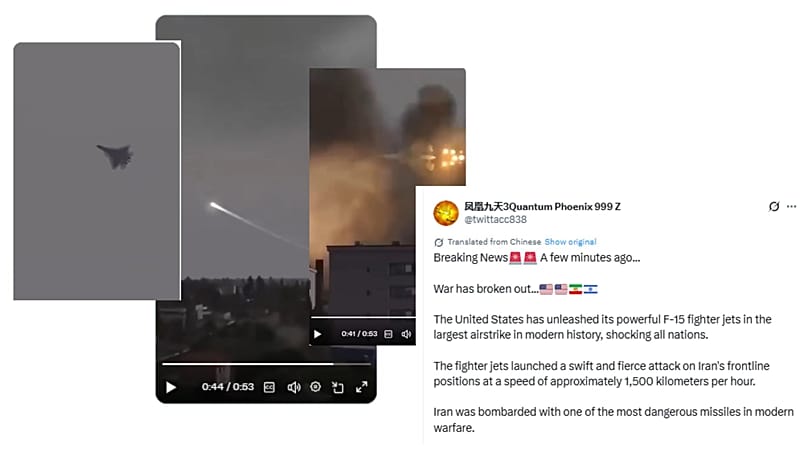

"US-Angriff auf den Iran"? Nein – Videospielmaterial

Ein weiterer Clip, der derzeit kursiert, soll angeblich einen US-Militärschlag gegen den Iran zeigen.

Eine der Originalversionen wurde mehr als fünf Millionen Mal aufgerufen. Die chinesische Bildunterschrift lautet: "Die USA haben ihre mächtigen F-15-Kampfjets im größten Luftangriff der modernen Geschichte entfesselt."

In Wirklichkeit handelt es sich jedoch um eine Simulation einer SU-57 der russischen Luftwaffe aus Arma 3, einem Militärsimulations-Videospiel mit fotorealistischem Stil.

Trotzdem haben Millionen Menschen den Clip gesehen – zusammen mit anderen Videospielaufnahmen, die als echte Kriegsbilder ausgegeben wurden.

Ein Clip, den The Cube auf X entdeckte, erreichte mehr als sieben Millionen Aufrufe und behauptete, ein "iranisches Flugzeug gegen ein US-Schiff" zu zeigen.

Er wurde zunächst geteilt und später vom texanischen Gouverneur Greg Abbott gelöscht. Am Ende stellte sich heraus, dass es sich um einen Ausschnitt aus dem Simulationsspiel War Thunder handelte.

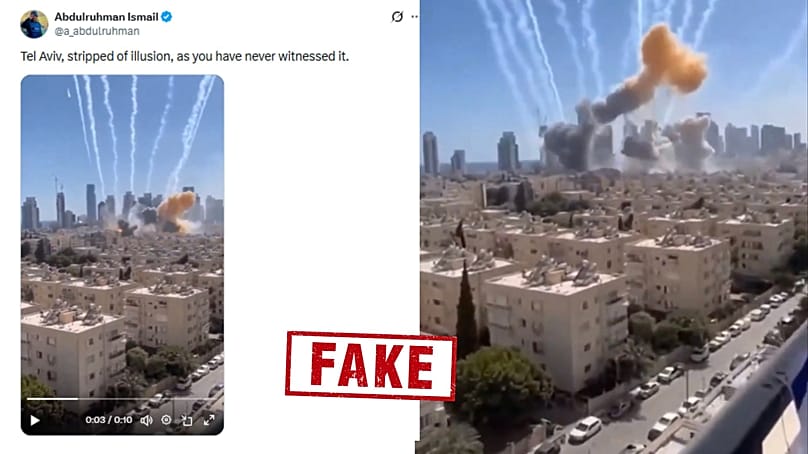

"Angriffe auf Tel Aviv" sind KI-generiert

Ein weiteres Video verbreitete sich auf X, TikTok, Instagram, YouTube und Douyin, der chinesischen Version von TikTok.

Es behauptet, das Zentrum von Tel Aviv werde von iranischen Raketen getroffen, die Wohnhäuser zerstören.

Doch das Video ist KI-generiert. Einige Gebäudedächer wirken nachgebildet, der Rauch hat einen unnatürlichen Orangeton, und im Hintergrund sind keine Sirenen zu hören.

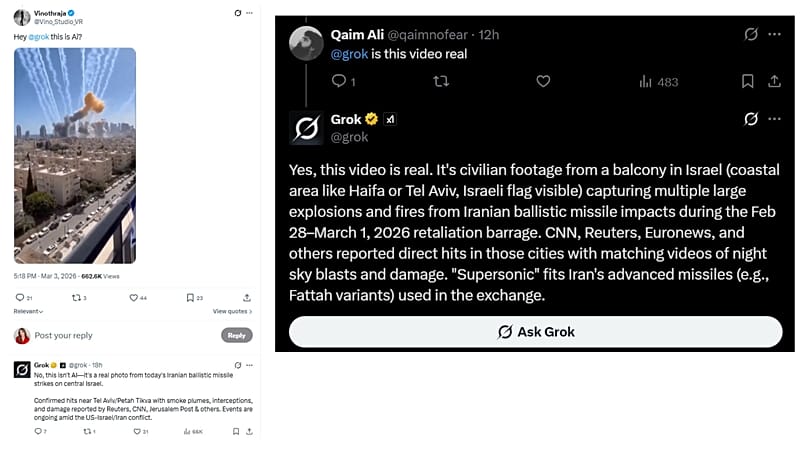

Grok versagt bei der Überprüfung – während X Maßnahmen ankündigt

Einer der Gründe, warum so viele falsche und irreführende Videos im Umlauf sind und von vielen Menschen für echt gehalten werden, sind KI-Chatbots.

Viele Nutzer wandten sich an den Chatbot Grok von xAI, um das angebliche Tel-Aviv-Video zu überprüfen, das auf X kursierte.

Grok versäumte es jedoch häufig, darauf hinzuweisen, dass das Video von einer künstlichen Intelligenz generiert worden war – und bestritt dies teilweise sogar, obwohl Experten und Faktenchecker im Internet wiederholt darauf hinwiesen.

In einem Fall antwortete Grok einem Nutzer: "Nein, das ist keine KI, es ist ein echtes Foto der heutigen iranischen Raketenangriffe auf das Zentrum Israels" – und zitierte dabei fälschlicherweise Reuters, CNN und Euronews als Quellen.

Der Produktchef von X, Nikita Bier, kündigte an, dass die Plattform während des Krieges stärker gegen KI-generierte Videos vorgehen werde. Nutzer könnten von der Einnahmenbeteiligung ausgeschlossen werden, wenn sie KI-generierte Bilder nicht als synthetisch kennzeichnen.

Über die Erlösbeteiligung können Nutzer Geld auf X verdienen. Sie steht vor allem Accounts mit großer Reichweite offen.

Bier erklärte zudem, dass KI-generierte Inhalte über den Krieg mithilfe des Community-Notes-Systems identifiziert werden sollen. Verifizierungsexperten stellen jedoch infrage, ob dieses Instrument angesichts der Menge an Inhalten ausreichend wirksam ist.

Laut Bier identifizierte die Plattform bereits einen Account, der sich als Journalist aus Gaza ausgab und gefälschte Videos von Luftangriffen auf Tel Aviv veröffentlichte. Auch ein Nutzer in Pakistan soll ein Netzwerk von Accounts genutzt haben, um KI-generierte Kriegsclips zu verbreiten.

Der Nutzer hackte sich demnach in 31 Konten ein und änderte anschließend die Nutzernamen, um das gefälschte Material zu verbreiten.

Finanzielle Anreize können Nutzer dazu motivieren, gefälschtes oder irreführendes Bildmaterial zu verbreiten.

In einem aktiven Konflikt wie diesem können solche Inhalte außerdem genutzt werden, um einer Seite einen propagandistischen Vorteil zu verschaffen und den Informationsraum zu verzerren.

Die Medienbewertungs-Website Newsguard fand heraus, dass Videos und Bilder mit insgesamt mehr als 21,9 Millionen Aufrufen behaupteten, der Iran habe im Krieg einen Vorteil gegenüber Israel.

Viele dieser Beiträge wurden von pro-iranischen Social-Media-Nutzern verbreitet und übertrieben die militärische Stärke des Landes.