Hunderte KI-generierte ICE-Clips sind in den sozialen Medien millionenfach aufgerufen worden. Das zeigen die Daten, die The Cube nach dem ZDF-Fake-Video eingesehen hat.

Das ZDF hat Ende Februar einer US-Korrespondentin abberufen, nachdem sie ein von künstlicher Intelligenz generiertes Video in einem Bericht des Heute-Journal über die US-Einwanderungs- und Zollbehörde ICE verwendet hatte.

WERBUNG

WERBUNG

WERBUNG

WERBUNG

Der Sender entschuldigte sich für die Verwendung des Clips. Darauf zu sehen sind Kinder, die sich an ihre Mutter klammern, während sie von ICE-Agenten verhaftet wird. Das Video war mit einem Sora-Wasserzeichen versehen, dies ist ein deutlicher Hinweis darauf, dass es mit dem Video-Tool von OpenAI erstellt wurde.

The Cube, das Faktencheck-Team von Euronews, fand heraus, dass das Video nur eines von Tausenden KI-generierter Clips von ICE-Agenten ist, die die sozialen Medien überschwemmen. Viele davon sind ohne klare Kennzeichnung und erreichen millionenfache Klicks.

Konsistentes Muster

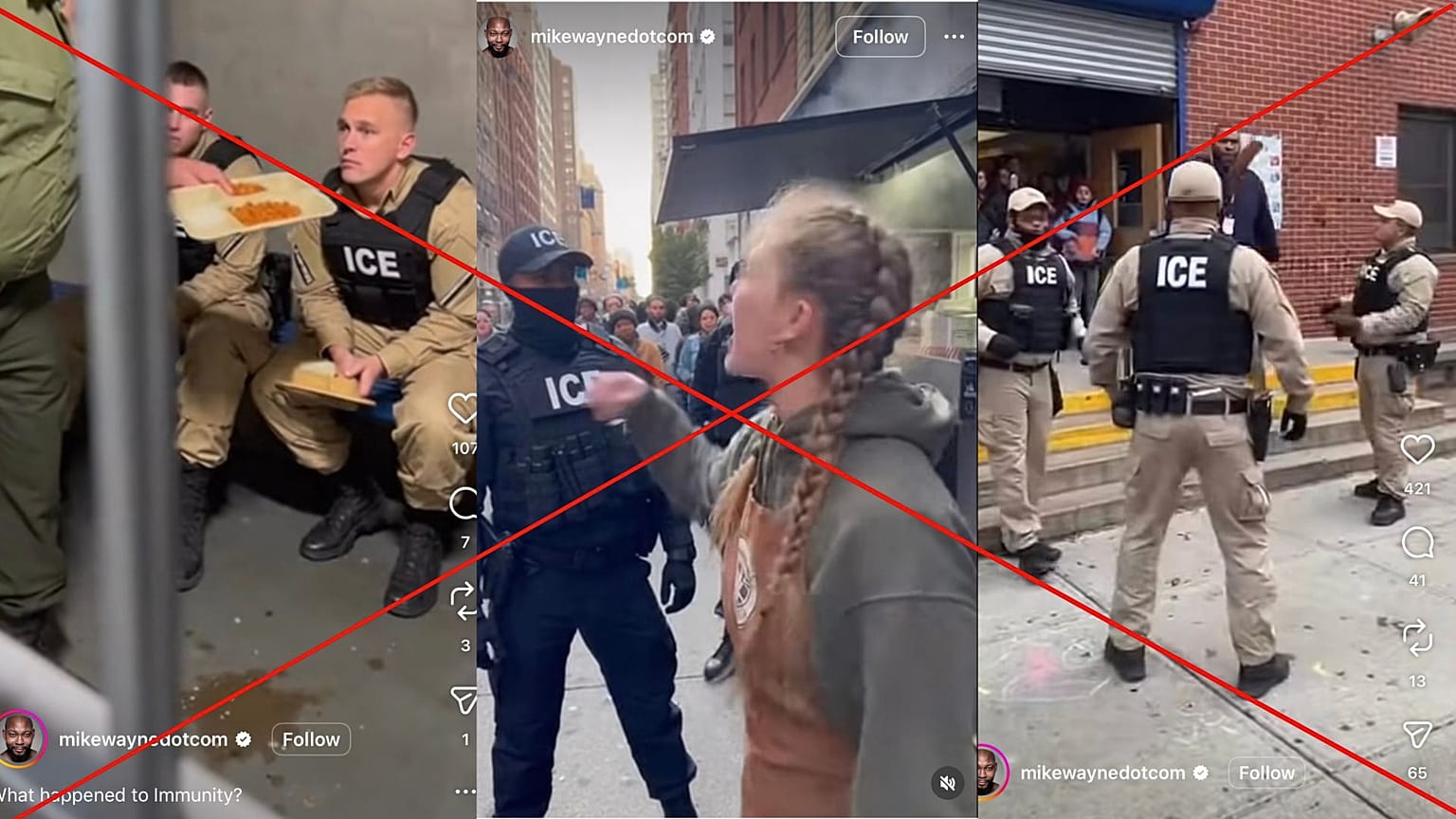

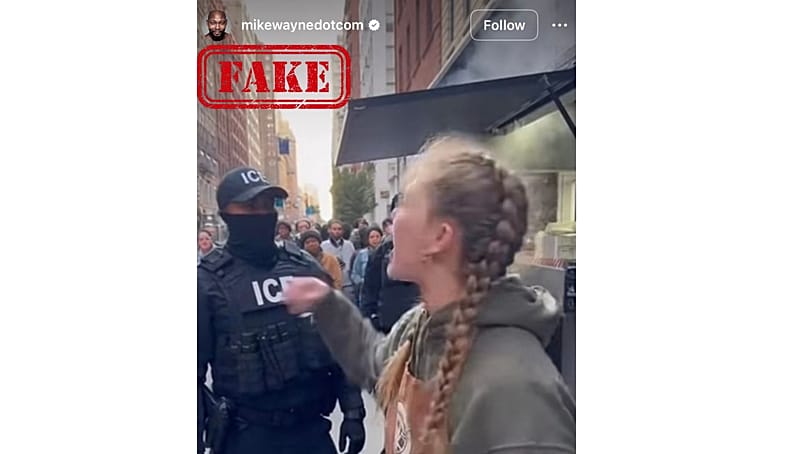

Die Daten, die das KI-Erkennungsunternehmen TruthScan mit The Cube geteilt hat, zeigen hunderte kurze Clips, in denen ICE-Agenten von Lehrern gejagt werden, sich in Bars prügeln und von Beamten des NYPD (New York City Police Department) in der U-Bahn verhaftet werden.

TruthScan hat nach eigenen Angaben mehr als 200 Videos von einem einzigen Instagram-Account ausgegraben. Die Videos sind kurz, dramatisch und gefühlsbetont.

The Cube zeigt auf, dass der Account immer noch massenhaft KI-generierte Clips von ICE postet, von denen einige Tausende und andere Millionen von Aufrufen erhalten.

Es gibt verschiedene Hinweise darauf, dass die Videos nicht echt sind: In einem Beispiel scheint während einer Konfrontation zwischen einem ICE-Agenten und einer Café-Mitarbeiterin Dampf durch eine feste Oberfläche hindurch aufzusteigen - ein subtiles Zeichen dafür, dass der Clip nicht authentisch ist.

Laut TruthScan war jedes Video entweder genau 10 oder 15 Sekunden lang, was stark darauf hindeutet, dass sie mit dem Sora 2-Videomodell von OpenAI erstellt wurden, das den Nutzern das Erstellen von 10- oder 15-Sekunden-Videos anbietet.

Im Gegensatz zu vielen KI-generierten Videos, die ein Wasserzeichen enthalten, ist dies bei den meisten ICE-Clips nicht der Fall.

Von KI-generierten Clips von ICE-Agenten, die auf Facebook viral gingen, berichtete 404 Media schon im November 2025. Ein Post allein erreichte 4 Millionen Aufrufe. Docj die Videos sind inzwischen entfernt worden.

Gefahr für das öffentliche Vertrauen

Experten zufolge besteht nicht nur die Gefahr, dass einzelne Clips falsch gekennzeichnet sind, sondern auch, dass sich gefälschte Inhalte zu sensiblen politischen Themen weiter verbreiten. So wird das Vertrauen der Öffentlichkeit ganz generell und vor allem in Medien, Politik und Behörden untergraben.

"Es besteht ein erhebliches Risiko für die kollektiven Reaktionen auf die Maßnahmen der Strafverfolgungsbehörden, sowohl in negativer als auch in positiver Hinsicht", so Ari Abelson, Mitbegründer von OpenOrigins, einem Unternehmen für Medienauthentizität, das Deepfakes aufspürt.

"Es ist ein Problem für die Strafverfolgungsbehörden, die ihr Vertrauen bewahren wollen, aber es ist auch wichtig für die Institutionen, die sie zur Verantwortung ziehen, wenn sie zu weit gehen", erklärt Abelson im Gespräch mit The Cube.

Wie bei der ZDF-Nachrichtensendung sind die KI-generierten ICE-Inhalte nicht auf anonyme Konten beschränkt. Besonders in den USA sind sie bereits in den höchsten Rängen der politisch Verantwortlichen präsent.

Im Januar 2026 veröffentlichte das Weiße Haus ein digital verändertes Bild der Aktivistin und Anwältin Nekima Levy Armstrong nach ihrer Verhaftung bei einer ICE-Demonstration in Minnesota.

Das veränderte Bild zeigt Armstrong schluchzend, während sie auf dem Originalbild unbeeeindruckt scheint.

Das Weiße Haus reagierte auf Fragen zur Manipulation des Bildes mit einem Post des stellvertretenden Kommunikationsdirektors Kaelan Dorr, in dem es heißt: "Noch einmal an die Leute, die das Bedürfnis haben, reflexartig Täter zu verteidigen, die in unserem Land abscheuliche Verbrechen begangen haben: Ich teile Ihnen diese Botschaft mit: Die Durchsetzung des Gesetzes wird weitergehen. The memes will continue."

Die Anwältin Armston sagte, sie sei "disgusted" ("angewidert") vom Weißen Haus, weil es das Bild veröffentlicht habe.

Laut dem Experten Abelson ist es besorgniserregend, wenn es an Hinweisen mangelt, die deutlich machen, dass der Inhalt gefälscht ist.

"Politische Karikaturen wurden schon immer in der Politik verwendet, und diese werden auf sehr ähnliche Weise eingesetzt", sagt er. "Der entscheidende Unterschied ist, dass die Videos immer hyperrealistischer werden."

"Soziale Räume und Informationsräume brauchen eines: die Möglichkeit, zu beweisen, dass ein Foto oder ein Video echt ist, damit wir die Fälschungen als Fiktion genießen und die Ernsthaftigkeit von Ereignissen im wirklichen Leben spüren können", meint Ari Abelson.