Ein KI-System kann die Gedanken von Menschen in Text übersetzen, indem es ihre Gehirne scannt.

Künstliche Intelligenz hat in den letzten Monaten gezeigt, dass sie in der Lage ist, wie ein Mensch zu schreiben, atemberaubende Bilder und Videos zu erstellen und sogar Songs zu produzieren, die die Musikindustrie aufrütteln.

WERBUNG

WERBUNG

WERBUNG

WERBUNG

Jetzt haben Forscher:innen eine weitere potenzielle Anwendung enthüllt, die große Auswirkungen haben könnte - KI, die im Grunde genommen "Gedanken lesen kann". Sie haben an einem neuen KI-System gearbeitet, das die Gehirnaktivität eines Menschen in einen kontinuierlichen Textstrom übersetzen kann.

Das System, das als semantischer Decoder bezeichnet wird, misst die Gehirnaktivität mit einem fMRI-Scanner (funktionelle Magnetresonanztomographie) und kann allein aus der Gehirnaktivität Text erzeugen.

Die Forscher:innen von der University of Texas in Austin, die hinter dieser Arbeit stehen, sagen, dass die KI eines Tages Menschen helfen könnte, die zwar bei Bewusstsein sind, aber nicht sprechen können, wie zum Beispiel Menschen, die einen schweren Schlaganfall erlitten haben.

"Für eine nicht-invasive Methode ist das ein echter Sprung nach vorn im Vergleich zu dem, was bisher gemacht wurde, nämlich typischerweise einzelne Wörter oder kurze Sätze", sagte Alex Huth, Assistenzprofessor für Neurowissenschaften und Informatik an der UT Austin und einer der Autoren der Arbeit.

"Wir bringen das Modell dazu, kontinuierliche Sprache über längere Zeiträume mit komplizierten Ideen zu dekodieren." Es gibt bereits andere Systeme zur Sprachdekodierung, die jedoch chirurgische Implantate erfordern und als invasive Systeme eingestuft werden.

Der semantische Decoder ist ein nicht-invasives System, da keine Implantate erforderlich sind. Im Gegensatz zu anderen Decodern sind die Probanden auch nicht auf die Verwendung von Wörtern aus einer vorgegebenen Liste beschränkt. Der Decoder wird umfassend mit fMRI-Scans trainiert, während die Testperson stundenlang Podcasts anhört. Danach hört die Testperson eine neue Geschichte oder stellt sich vor, wie sie eine Geschichte erzählt, und ihre Gehirnaktivität erzeugt den entsprechenden Text.

Entschlüsselung "des Kerns" des Gedankens

Die Forscher:innen erklärten, dass die Ergebnisse keine wortgetreue Abschrift dessen sind, was die Versuchsperson in ihrem Kopf hört oder sagt, sondern dass der Decoder "das Wesentliche" von dem erfasst, was gedacht wird. Bei etwa der Hälfte aller Fälle ist die Maschine in der Lage, einen Text zu produzieren, der der beabsichtigten Bedeutung der ursprünglichen Wörter sehr nahe kommt - und manchmal sogar genau entspricht.

In einem Experiment hörte eine Person zum Beispiel einen Sprecher sagen: "Ich habe noch keinen Führerschein", und die Maschine übersetzte ihre Gedanken mit: "Sie hat noch nicht einmal angefangen, Autofahren zu lernen."

Während der Tests baten die Forscher:innen die Versuchspersonen auch, sich kurze stumme Videos anzusehen, während sie gescannt wurden, und der Decoder war in der Lage, ihre Gehirnaktivität zu nutzen, um einige Ereignisse aus den Videos genau zu beschreiben.

Die Wissenschaftler:innen glauben, dass das Verfahren auf tragbarere Systeme zur Bildgebung des Gehirns wie die funktionelle Nahinfrarotspektroskopie (fNIRS) übertragen werden könnte. Dieses Verfahren ist derzeit für einen breiteren Einsatz nicht geeignet, da es auf fMRI-Geräte angewiesen ist.

"fNIRS misst, wo im Gehirn zu verschiedenen Zeitpunkten mehr oder weniger Blut fließt, was, wie sich herausstellt, genau die gleiche Art von Signal ist, die fMRI misst", so Huth. "Unser Ansatz sollte sich also genau auf fNIRS übertragen lassen", auch wenn die Auflösung bei fNIRS geringer ist.

Gefahr von Missbrauch?

Die Forscher:innen äußern sich auch zu Bedenken hinsichtlich eines möglichen missbräuchlichen Einsatzes dieser Technologie. Hauptautor Jerry Tang sagte: "Wir nehmen die Bedenken sehr ernst, dass es für schlechte Zwecke verwendet werden könnte, und haben daran gearbeitet, dies zu vermeiden."

Sie betonen, dass das System nicht gegen den Willen einer Person eingesetzt werden kann, weil es an einem willigen Teilnehmer ausgiebig trainiert werden muss. "Eine Person muss bis zu 15 Stunden in einem Kernspintomographen liegen, vollkommen ruhig sein und den Geschichten, die sie hört, gut zuhören, bevor das System wirklich gut funktioniert", erklärte Huth.

Die Ergebnisse wurden in der Zeitschrift Nature veröffentlicht.

Bilder im Kopf entschlüsseln

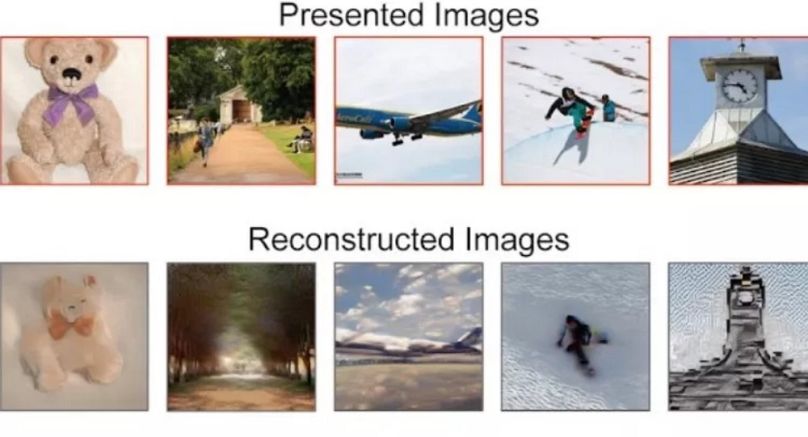

Die Übersetzung von Gehirnaktivität in geschriebene Worte ist nicht das Einzige, womit Forscher:innen künstliche Intelligenz testen. Eine weitere Studie, die im März veröffentlicht wurde, zeigt, wie KI Gehirnscans lesen kann, um Bilder wiederzugeben, die eine Person gesehen hat.

Die Forscher:innen der Universität Osaka in Japan verwendeten Stable Diffusion - einen Text-Bild-Generator, ähnlich wie Midjourney und OpenAIs DALL-E 2.

Dieses System war in der Lage, visuelle Erfahrungen aus der menschlichen Hirnaktivität zu rekonstruieren, wiederum dank fMRI-Gehirnscans, die aufgenommen wurden, während eine Testperson einen visuellen Reiz betrachtete.