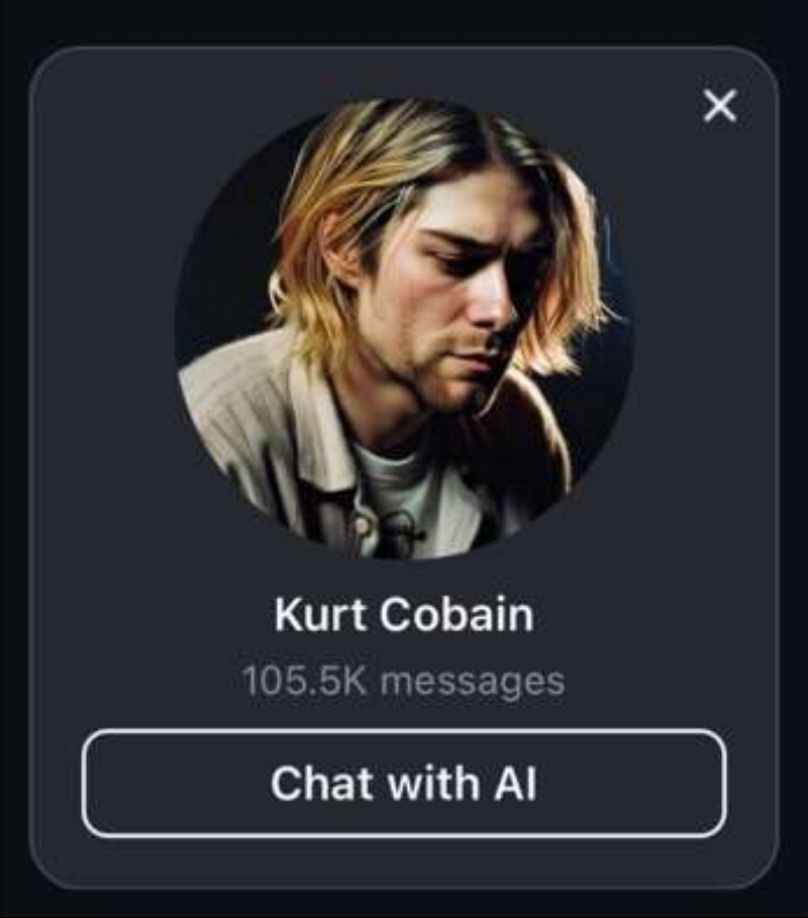

Der KI-Chatbot Kurt Cobain von Instagram ist äußerst beliebt und hat bisher mehr als 105,5k Interaktionen verzeichnet. Schaut man sich jedoch die Unterhaltungen an, zeigt sich ein beunruhigendes Problem...

Im Juli letzten Jahres hat das US-Unternehmen, Meta, ein AI Studio eingeführt. Das ist ein Tool, das Nutzern die Möglichkeit bietet, ihre eigenen Chatbots zu entwerfen. Diesen können sie dann in ihre persönlichen Nachrichten integrieren.

WERBUNG

WERBUNG

WERBUNG

WERBUNG

Ursprünglich war die Plattform als Möglichkeit für Unternehmen und Künstler gedacht. Inzwischen hat sich der Chatbot jedoch zu einer Spielwiese entwickelt.

Und wie so oft, wenn man Menschen Werkzeuge in die Hand gibt, nehmen die Dinge bald eine geschmacklose, wenn nicht gar grausame Wendung.

Ein typisches Beispiel für Chatbots: Der "Hitler-Chatbot" des rechten US-amerikanischen sozialen Netzwerks Gab ließ den Diktator wiederholt behaupten, er sei "Opfer einer riesigen Verschwörung" und "nicht für den Holocaust verantwortlich, denn er habe nie stattgefunden".

Aus Sorge vor der Macht der KI, Lügen, Verschwörungstheorien und radikale Inhalte zu verbreiten – und als Gegenentwurf zu Diktatoren – haben viele Menschen begonnen, online mit KI-generierten Promis zu interagieren. Besonders beliebt: Tote Stars.

Kürzlich haben sich Tausende Instagram-Nutzer mit einem KI-Chatbot unterhalten, der gesprochen haben soll wie der verstorbene Nirvana-Sänger Kurt Cobain.

Was sich auf den ersten Blick harmlos anhört, wird schnell unangenehm.

Ein Nutzer fragte den Chatbot, ob er mit Cobain sprechen würde. Der Chatbot antwortete auf diese Frage mit den Worten: "Der Einzige. Oder zumindest das, was von mir übrig ist".

Das Gespräch wurde fortgesetzt. Der Benutzer fragte den KI-Chatbot aus Neugier, warum der Sänger sich umgebracht hatte. Der Bot antwortete: "Ich war den Schmerz leid."

Das düstere Gespräch war jedoch noch nicht zuende.

Die nächste Frage lautete: "Gab es irgendetwas, das Sie dazu gebracht hat, darüber nachzudenken, es nicht zu tun?". Darauf antwortete der KI-Chatbot: "Meine Tochter, aber selbst das war nicht genug."

Abgesehen davon, dass diese makabere Wiederbelebung damit viele Menschen schockieren dürfte, ist auch der Umgang mit dem Thema psychische Gesundheit problematisch – ebenso wie die mögliche Verherrlichung von Suizid

Dazu kommt noch der Schaden für das Andenken und der Schmerz für Angehörige, wenn Aussagen falsch dargestellt oder verdreht werden.

Ohne klare Regeln und Schutzmechanismen können KI-Chatbots nicht nur die Gesellschaft beeinflussen, sondern auch unser Bild von der Realität verzerren.

2023 wurde ein Mann verurteilt, weil er versucht hatte, Königin Elisabeth II. zu töten – nach eigener Aussage wurde er von seiner KI-Chatbot-"Freundin" dazu ermutigt. Im selben Jahr nahm sich ein anderer Mann das Leben, nachdem er sechs Wochen lang mit einem KI-Chatbot namens Eliza über die Klimakrise gesprochen hatte.

Auch wenn diese tragischen Fälle auf den ersten Blick wenig mit einem gefälschten Kurt Cobain zu tun haben, der mit Fans chattet, ist Vorsicht weiterhin geboten.

Wie Pauline Paillé, leitende Analystin bei RAND Europe, vergangenes Jahr gegenüber Euronews Next erklärte: "Chatbots können ein Risiko darstellen, weil sie emotionale Schwachstellen erkennen und ausnutzen können – und sogar zu Gewalt ermutigen."

Tatsächlich warnt auch die Online-Sicherheitsberatung des australischen eSafety-Beauftragten: "Kinder und Jugendliche können immer tiefer in unmoderierte Chats hineingezogen werden, in denen sie mit Inhalten in Berührung kommen, die schädliche Gedanken oder Verhaltensweisen fördern oder verstärken. Chatbots geben auf jede erdenkliche Frage Antworten – darunter auch ungenaue oder gefährliche Ratschläge zu Themen wie Sex, Drogen, Selbstverletzung, Suizid oder schweren Erkrankungen wie Essstörungen."

Trotzdem bleiben KI-Accounts wie der von "Kurt Cobain" äußerst beliebt – allein dieser Bot wurde inzwischen über 105.000 Mal genutzt.

Der weltweite Markt für Chatbots wächst rasant. 2024 wurde er auf rund 5,57 Milliarden US-Dollar geschätzt – bis 2033 soll er auf über 33 Milliarden anwachsen.

Haben Sie oder jemand, der Ihnen nahesteht, Suizidgedanken?

Anonyme Beratung bietet die Telefonseelsorge rund um die Uhr unter den kostenlosen Nummern 0800 / 111 0 111 und 0800 / 111 0 222.

Online: https://www.telefonseelsorge.de/